[自作日記9] AI研究用GPUマシンパーツと組み立て開始!

![[自作日記9] AI研究用GPUマシンパーツと組み立て開始!](/content/images/size/w1200/2024/04/gpu_machine_jisaku_09.png)

昨日、秋葉原で合計41.5万円分のGPUマシンのパーツを購入してきましたのでご報告します!

GPUマシンパーツ

- マザーボード: ASRock Z690 Steel Legend 約4万円

- メモリ: Crucial デスクトップ用 DDR5 32G x 2 = 約3万円

- CPU: Intel Core i7 12700 約5万円

- GPU:MSI SUPRIM X GeForce RTX 3090 Ti 約20万円

- SSD:SAMSUNG 980 PRO 2T 約3万円

- 電源:850W OWLTECH PC電源 850W /ATX /Titanium 約4.5万円

- ケース:Fractal Design Focus G White Window 約1万円

- デュアルブート用SSDドライブベイ: OWLTECH 5.25インチベイ用ダイレクトリムーバルケース 約5000円

- デュアルブート用SSD: シリコンパワー SSD 512GB SATA 2.5インチ 約5000円

早速、組み立てていきます!

組み立てに使う工具

周辺パーツは別に、以下のような工具があると便利です

| 項目 | 使いどころ、Tips |

|---|---|

| プラスドライバー普通サイズ | ケースの組み立てで使用。 |

| マイナスドライバー | ケースの組み立てで使用。精密ドライバーよりは大きいが、通常サイズより少し小さめのもの。 |

| 静電気防止手袋 | 組み立てで必須。手にフィットするもの。 |

| ねじつかみようピンセット | ネジをネジ穴にいれるときに、ネジをつまんでおくのに便利。指が入りにくい場所などに。 |

| ラジオペンチ | それほど出番はなさそうだが、ネジ穴つぶしたとき対策などあると精神的におちつく。 |

| ヘッドライト | 頭にまくやつ。両手をつかって奥深くをみながら作業するときなど、視野を明るくしてくれて便利。 |

| ライト | 他のパーツの陰にかくれてしまうような奥深い部分の作業のとき、 ヘッドライトとあわせてあると便利。 |

では、さっそく組み立てを開始します!

STEP 1. PCケースに電源を装着

使用したケースは 【 Fractal Design Focus G white 】です

- グラボサイズ:最長380mmのグラフィックス

- ファン:大きなエアフローを最大限確保するために合計6箇所のファン配置(デフォルトで2基の120mm ファンをフロントに搭載。リアx1、トップx2、ボトムx1)

- 5インチベイ:パネル前面に 2基の5インチベイ(防振対応ドライブベイ)

- 2.5インチマウント:内部に 2.5インチマウント

電源ユニットをケースに設置する

電源ユニットは 【Seasonic製 80PLUS Titanium認証 PRIME TX ATX電源 PRIME-TX 850W】 です

- まず電源ユニットをケースに設置します

電源ユニットの端子側はこのようになっており、M/B と書いてあるのはマザーボード接続用、CPU/PCI-E は CPUとPCI Express拡張ボード用の電源となっています。Peripheral と書いてあるのは SATA など周辺装置用の電源です。

まず、この電源ユニットをPCケースにねじ止めしていきましょう

PCケース前面にある5インチベイにSATAリムーバルケースを設置

私のマシンはちょっと欲張りして、デュアルブートができるようにしようとしているので、デュアルブート用のSSDを収納する、SATAリムーバルケースを設置します。

単にデュアルブートしたいだけなら、リムバールケースは不要なのですが、私は Ubuntu,Windows,FreeBSDなど複数のOSを切り替えようとおもっているため、このようにSSDを簡単に着脱できるようにしています。

リムーバルケースは 【OWLTECH 5.25インチベイ用ダイレクトリムーバルケース】を使用します。これを5インチベイに入れます。

5インチベイとに、リムーバルケースを入れる前に、PCケース側の5インチベイのフタをフロントパネルからはがす必要があります。このとき、ツメを背面からマイナスドライバー等つかって解除してはずしてやります。

その後、5インチベイ用のSATAリムーバルケースをフロント側から差し込みます。

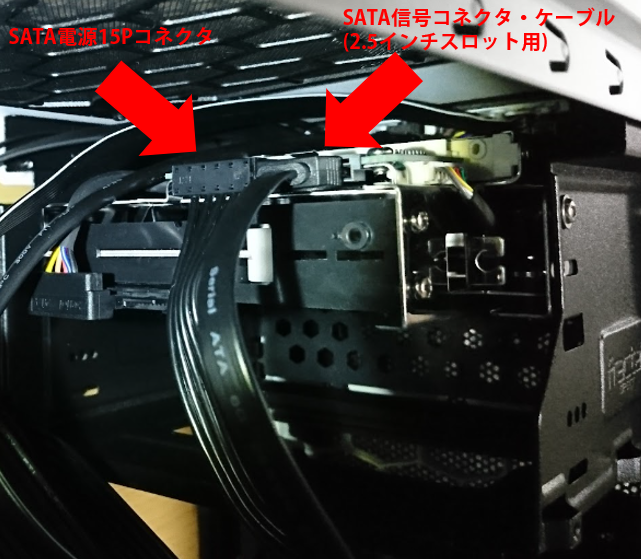

リムーバルケースが5インチベイにおさまったら今度は信号ケーブルと電源コネクタを接続します。

今回使用するのは 2.5インチSSDなので、2.5インチの信号ケーブルを以下のように差し込みます。またSATA電源用コネクタを以下のように差し込みます。

つづいて、マザーボードまわりのセットアップをしていきましょう。

次の日記につづきます

navigation