[自作日記8] 電源、SSD、ケースは?

![[自作日記8] 電源、SSD、ケースは?](/content/images/size/w1200/2024/04/gpu_machine_jisaku_08.png)

今日は電源、SSD、ケースの購入です!

Junです。

残りは電源とSSD、ケースをゲットすれば一通り揃いそうです。

また、置手紙をみてみます。

⑥ SSD は 1T以上。

⑦ 電源は 800W 以上、 80Plus Titanium

⑧ ケースはグラボがちゃんと入ることを確認すること!

SSDの選定

SSDは、1T以上ということで、 3万円の SAMSUNG 980 PRO 2T を購入。

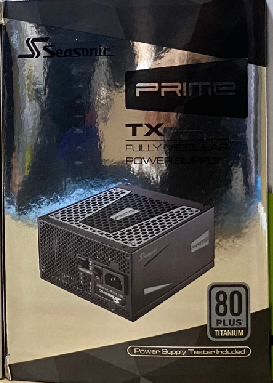

電源の選定

電源装置は 800W 以上ということで 850W OWLTECH PC電源 850W /ATX /Titanium PRIMETX850S を 4.5万円で購入しました。

ケースの選定

さて、残るはケースです。

⑧ ケースはグラボがちゃんと入ることを確認すること!

この意味がよくわからなかったので、店員さんに相談することにしました。

今回は ATX サイズのケースを購入する予定ですが、 ATX サイズといっても色々な大きさがあり、グラボのサイズが大きい場合、最悪ケースにおさまらないことがあるそうです。

なるほど、てきとうにケースを選ぶと痛い目にあうということですね。

今回かったグラボ GeForce RTX 3090 Ti SUPRIM X 24G のサイズは巨大で 338 x 140 x 71 mm です。フルサイズの PCI Express ボードが 31 cmなので、このグラボはフルサイズ超えの34cm サイズです。

たしかに、この巨大グラボが格納できるケースは注意深く探す必要がありそうです。

そこでよさげなケースをみつけました。

Fractal Design Focus G White Window というケースです。

このケースは 38cm までの グラボをサポートしており、私の買った GeForce RTX 3090 Ti SUPRIM X 24G の34cm というサイズでも余裕を持って入りそうです。

ちなみに、 GeForce RTX 3090 Ti SUPRIM X 24G は厚みもすごく 4スロット分あります。

つまり、PCI Express 4スロット分を占有するので、占有された場所にあった PCI Express スロットは使用不能になります。

(4スロットも占有するデカいグラボは許せん!と思う方は、コラム:コンシューマ用GPUとプロ用GPUの違い で解説した、内排気型のグラボをご検討されるとよいかなとおもいます。ブロワーファン搭載内排気型グラボはハイエンドのもので専有面積が2スロット以下のものがおおいです。そのかわり高価です)

そうそう、Fractal Design Focus G White Windowは見た目もかっこよく、パーツの居住空間も確保されているだけでなく、6基のファンや水冷ラジエーター取り付けにも対応しており、それでいてなんと約1万円で入手できました!これは間違いなくいい買い物だとおもいました。

実はこのケースを選定した理由はもう1つあります。それは5インチベイがついていることです。なぜ5インチベイがついていることが重要かといいますと、3分後にわかります。

さて、これで一通り、揃いました!

- マザーボード: ASRock Z690 Steel Legend 約4万円

- メモリ: Crucial デスクトップ用 DDR5 32G x 2 = 約3万円

- CPU: Intel Core i7 12700 約5万円

- GPU:MSI SUPRIM X GeForce RTX 3090 Ti 約20万円

- SSD:SAMSUNG 980 PRO 2T 約3万円

- 電源:850W OWLTECH PC電源 850W /ATX /Titanium 約4.5万円

- ケース:Fractal Design Focus G White Window 約1万円

合計でちょうど40.5万円! 半分はグラボの値段です!

さて、もう少し買い物をしようと思います。

え?もう40万円使ったじゃん?

とおもわれるかもしれませんが、そうなんです。会社が出してくれる費用はあと4.5万円あり、実はやりたいことがあり、もう少しだけ買い物をします。

やりたいことというのはデュアルブートです。

というのも、研究用のGPUマシンのOSは Linux (Ubuntu)なのですが、ドキュメンテーションなどでは、 Microsoft Office を使いたい私としてはウィンドウズも入れたいと思っており、このGPUマシンを AI研究+日常業務機としてもつかおうという野望があります。

そこで、あと1万円だけ使って、デュアルブート環境を整えたいとおもいます。

追加で以下を購入しました

実はさっきケースの選定で5インチベイがついている、というのが重要だったのおは、このリムーバルケースを入れたい為でした。

これで全部そろいました!

ついに Jun さんは、すべてのパーツを購入することができました。

SSDについて1つ補足しておきますと、

最近のマザーボードには M.2という小さなスロットがついています。過去PCの自作をしたことのある方なら SATA ケーブルをSSDに挿して使うということをやっていた方もいるかもしれませんが、最近は M.2 というスロットが主流です。それは以前のHDDのように記録媒体が大きくなく、マザーボードの表面に直接装備できるほどに小さくなったからです。

また M.2 には SATA 接続のものと MVNe 接続のものがあります。端子の形は M.2 ですが、 NVMe は通信速度が飛躍的に向上しており、今回 Jun が購入した SSD も NVMe 対応ですのでSATAとは比べ物にならないほど高速なアクセスをすることができます。このように SSD を M.2 NVMe にすることで小型かつ高速なストレージを追加することができますが、一般的に高額になります。

Junさんは、無邪気に2Tの M.2 NVMe を購入していましたが、コストが気になる場合は通常のSATA SSD を購入する手もあります。 Jun さんが追加購入された SSD は通常の SATA SSD 512GB ですが、こちらは5000円程度で購入できるものとなっており、もし速度を妥協できれば SATA SSD のみの構成にすれば数万円コストダウンすることも可能と思われます。

それでは、また、次回おあいしましょう!

navigation