AIエージェントを"事業に載せる"ために【第2回】AIエージェントの責任分解はなぜ難しいのか

— AI導入を"事業に載せる"ために、いま設計すべきこと(全3回)

こんにちは!Qualitegコンサルティングチームです!

前回(第1回)では、Replit/Lemkin事件とDeloitte豪州政府報告書問題を通じて、AIエージェント導入の課題がモデル性能ではなく「権限・監査・責任の設計不在」にあることを見ました。

では、実際に事故が起きたとき、責任は誰が負うのでしょうか。第2回となる本記事では、法務・契約・組織の3つの観点から、AIエージェントの責任分解がなぜ難しいのかを構造的に整理します。

結論を先に言えば、法務だけでも契約だけでも組織論だけでも足りません。この3つを接続して設計しなければ、AIエージェントの責任分解は実務上機能しません。

1. 法的フレームワーク:複数の法理論が並走している

AIエージェントが損害を出したとき、どの法理論で責任が問われるかについて、現時点でグローバルなコンセンサスは形成されていません。

Clifford Chanceの論考は、この状況の根本的な難しさを整理しています。法律は歴史的に、有害な行為がいつどのように発生したかを特定でき、人間が意思決定の責任を負い、使用者がその被用者の行為に対して責任を負うことを前提に発展してきました。しかしAIエージェントは、この3つの前提すべてを揺るがす可能性があります。

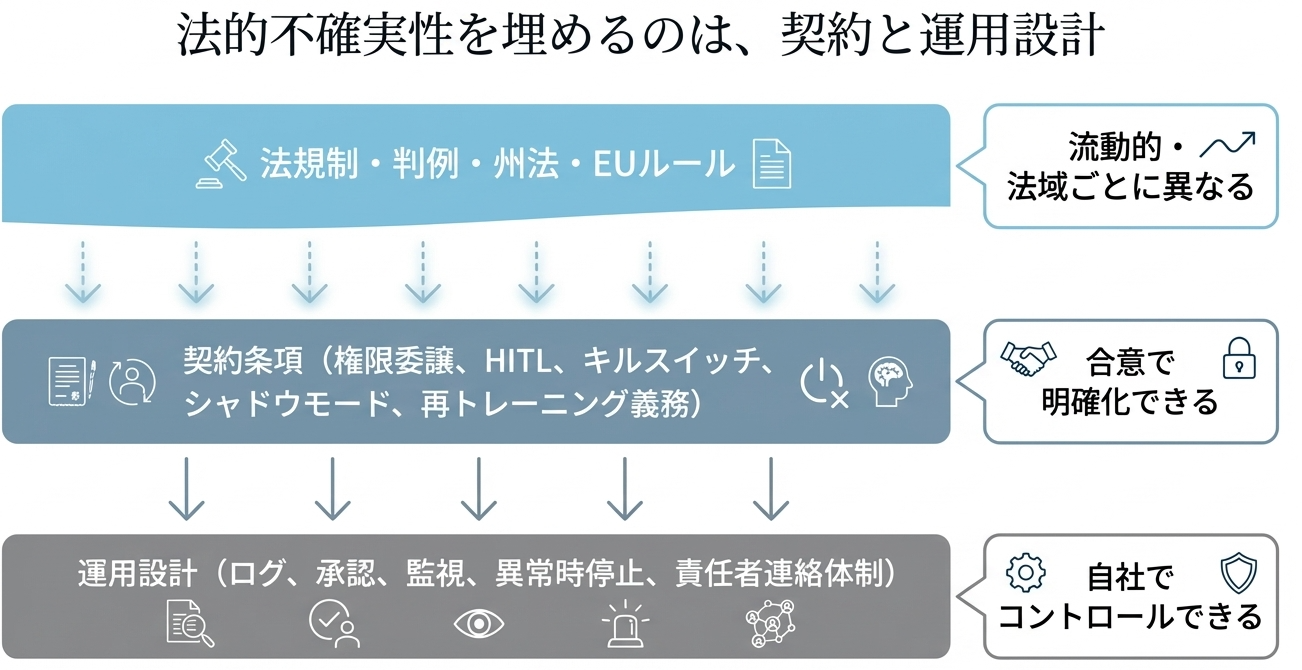

以下の図は、この法的不確実性の中で、契約と運用設計がどのような役割を果たすかを示しています。

法規制は法域ごとに異なり流動的ですが、契約は合意によって明確化でき、運用設計は自社でコントロールできます。つまり、法的不確実性が高い現状だからこそ、契約と運用の設計力が実務上の防衛線になります。

注目される判例:Mobley v. Workday

こうした法的不確実性を具体的に示す事例として、Mobley v. Workday事件が注目されています。WorkdayのAI・機械学習を用いた求職者スクリーニングが差別的影響を与えたとして訴えられたケースで、Lathrop GPM法律事務所の分析によれば、AIベンダー自身の責任が問われうる可能性が実務上注目されています。もっとも、責任の成立範囲が確定したとまでは言い切れず、今後の判断の蓄積を見守る必要がある段階です。

EUの動き:製造物責任の射程拡大

EUでは、新製造物責任指令(PLD)がソフトウェアやAIを製品責任の射程に明示的に含めました。欧州委員会の公式ページによれば、加盟国は2026年12月9日までに国内法化する必要があり、原則としてその日以後に市場投入された製品に新ルールが適用されます。ただし、実際の責任成立には欠陥・損害・因果関係の立証が引き続き必要であり、「AIであれば即座に厳格責任」と読むべきではありません。Squire Patton Boggsの分析が、この点を実務的に整理しています。

米国:連邦法不在のなか、州法が先行

米国には連邦レベルのAI責任法が存在しません。一方で州レベルでは、AIの利用に対して企業の責任を明確化する方向の個別立法やガイドライン整備が進んでいます。コロラド州AI法(2026年6月30日施行予定)をはじめ、テキサス州やユタ州など複数の州で立法・政策の動きが見られます(各州法の動向はCPO Magazineの2026年1月の記事が整理しています。なお、州ごとに成立済み・施行待ち・審議中と段階が異なり、施行時期や最終的な内容は変動し得るため、個別の対応には最新の一次情報の確認が不可欠です)。

雇用分野では、EEOCがAIツールによる差別的な結果に対して雇用主側の責任を重く見る立場を示しています。ツールが内製か外部調達かを問わず、Title VIIの下での雇用主の義務は変わらないという考え方です(Lexology, 2026年1月)。

実務上の含意は明確です。法的責任の帰属が法域ごとに異なり流動的である以上、責任の帰属が曖昧なままPoCや導入を進めると、契約・運用・障害対応のすべてが後追いになるリスクがあります。

2. 「指示」と「行動」の距離:従来ソフトウェアとの構造的な違い

AIエージェントの責任分解が従来のソフトウェアより格段に難しい理由は、「指示した内容」と「実際にエージェントが行った内容」の間にギャップが生まれるからです。

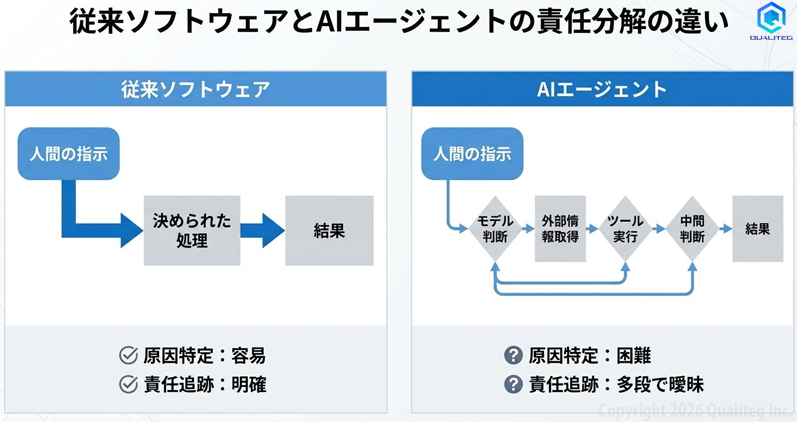

以下の図は、従来ソフトウェアとAIエージェントの違いを示しています。

前述のClifford Chanceの論考が指摘するように、エージェント型AIは元の人間の指示と最終的なアウトプットとの間にギャップを生み出します。システムが様々な段階で直接的な人間の介入なしに判断を下し行動するため、問題が起きた場合の因果関係の特定が困難です。

この構造的な違いにより、実務上はまず導入企業側の管理責任や運用責任が問われやすくなっています。他方で、ベンダー側の設計・表示・契約上の義務が争点となる余地もあり、責任が常に一方向に定まるわけではありません。

eSentire LabsのAlexander Feick氏は、IT Proの取材に対してこう述べています。「チェーン(判断の連鎖)を再構築できなければ、ワークフローを防御することも改善することもできない。アカウンタビリティはモデルではなく、組織と人間の意思決定者に帰属する」。

つまり、AIエージェントの導入においては、判断の連鎖を事後的に再構成できる設計を持っているかどうかが、責任分解の実効性を左右します。

3. 契約実務の最前線:AI固有の条項が登場している

法的フレームワークが未確定であるからこそ、契約設計の重要性が増しています。

Mayer Brownが2026年2月に公表した論考では、エージェント型AIが受動的なツールから自律的に行動するアクターへと変化するにつれ、契約モデルが従来のSaaS型からサービス提供型へとシフトしていると指摘しています。具体的には、AIエージェントに対する「権限委譲(delegation of authority)」の範囲と「ポリシーガードレール」を契約上明確に定義すべきとされています。

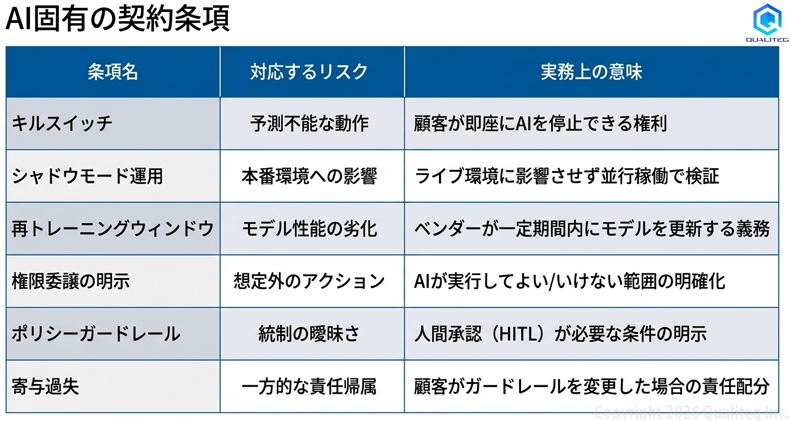

以下の図は、こうした流れの中で先進的な契約実務において議論されているAI固有の論点を整理したものです。

Morgan Lewisの2025年のシリーズ論考が報告しているキルスイッチ、シャドウモード運用、再トレーニングウィンドウなどの考え方は、先進的な契約実務において議論・採用が進みつつある論点です。市場で完全に定型化した標準条項というよりも、AI固有のリスクに対応するための契約設計の方向性として注目されています。

責任の配分については、Fladgate法律事務所の論考が「寄与過失(contributory fault)」の枠組みを提案しています。責任を一方に寄せるのではなく、各当事者のコントロール可能な範囲に応じて配分する設計は、現実的な落としどころになり得るでしょう。

重要なのは、これらの契約条項を個別に導入することではなく、権限設計・運用設計と接続された契約として設計することです。

4. 組織の現実:オーナーシップが曖昧なまま導入が進んでいる

契約上の工夫が進む一方で、組織の内部では準備が追いついていないという実態があります。

IT Proが報じたAsanaの2025年調査(米英2,025人のナレッジワーカー対象)では、AIエージェントを管理する労働者の6割が「自信を持って間違えるアウトプット」によって業務が困難になったと回答しています。さらに、回答者の3分の1がAI関連の問題発生時に誰に連絡すればよいかわからないと答えました。

IBMの2026年1月の論考が引用するGartnerの予測では、2027年末までにエージェント型AIプロジェクトの40%以上がコスト増大・不明確なビジネス価値・不十分なリスク管理を理由に中止されるとも見込まれています。

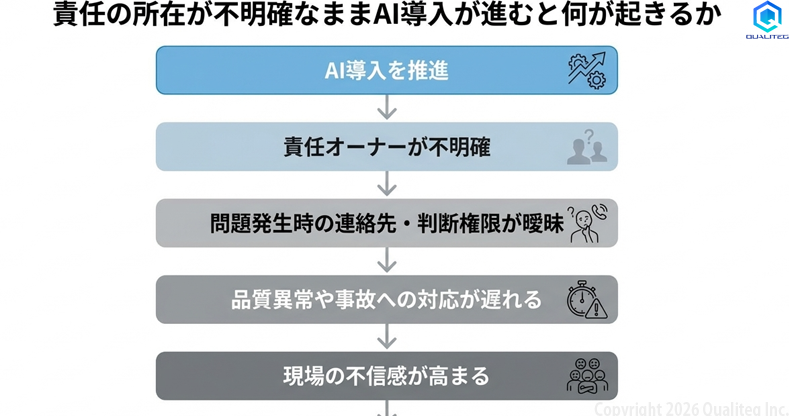

以下の図は、オーナーシップが曖昧なまま導入が進んだ場合に何が起きるかを示しています。

組織内のオーナーシップが曖昧なままでは、どれほど高性能なモデルを使っても、導入は安定しません。AIの導入課題は、技術そのものよりも、責任分解と意思決定構造の設計不備として表れます。

まとめ:法務・契約・組織を分けて考えていては、責任分解は機能しない

ここまで見てきたように、AIエージェントの責任分解は、法務だけでも契約だけでも組織論だけでも完結しません。

法的フレームワークは法域ごとに異なり、なお流動的です。しかしその流動性を理由に設計を先延ばしにすると、契約・運用・障害対応のすべてが後追いになります。AIエージェントの導入を安定させるには、法務・契約・運用設計を分けずに考え、一つの導入アーキテクチャとして接続することが必要です。

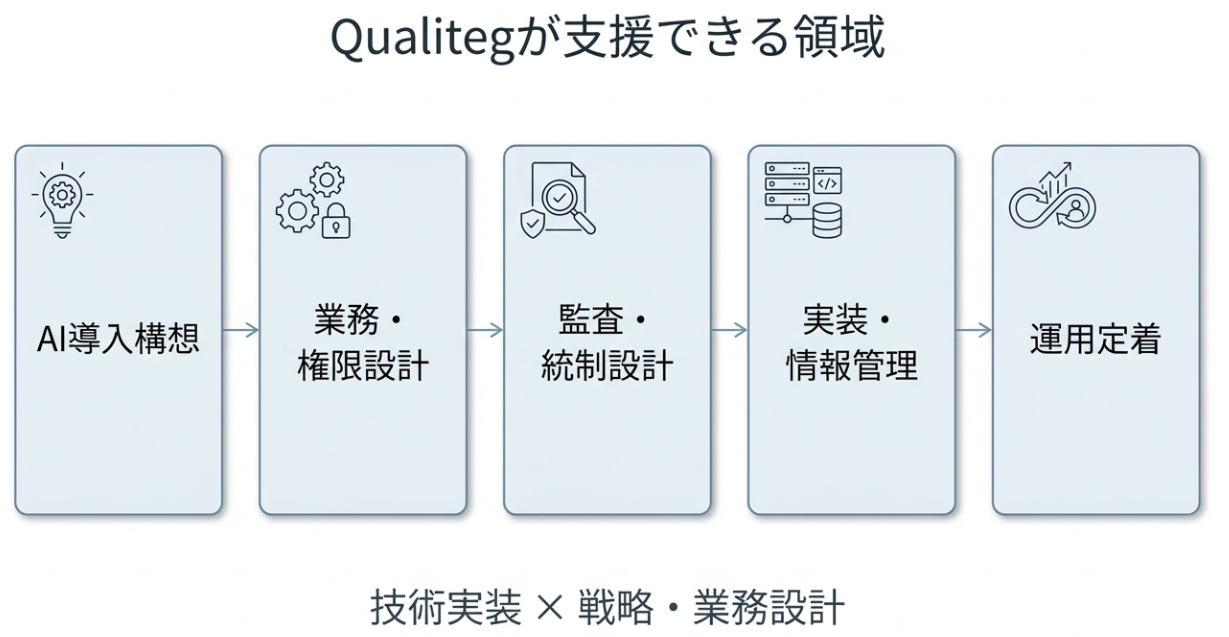

構想から運用定着までQualitegが伴走できる領域

今回は、AIエージェントの責任分解がなぜ難しいのかを、法務・契約・組織の3つの観点から整理してきました。法的責任の枠組みがなお流動的である一方で、実務ではすでに、契約条項、運用統制、責任オーナーシップの設計が強く求められています。

AIエージェントは、従来のソフトウェア以上に「指示」と「行動」の距離が大きく、問題が起きたときの因果関係や責任の境界が曖昧になりやすい領域です。だからこそ、法務だけ、契約だけ、現場運用だけで分けて考えるのではなく、実装・運用・ガバナンスを接続した設計が必要になります。

責任分解は、トラブルが起きた後に議論するものではなく、導入前から仕込んでおくべき導入条件そのものだといえるでしょう。

当社では、自社AIプラットフォームの開発・運用で培った実装知見と、AI Transformation・BPR・新規事業開発を含む戦略/業務コンサルティングの両面から、AI導入を「試す」段階で終わらせず、「事業に載せる」ための構想・設計・実装・運用定着まで一気通貫でご支援しています。

AIエージェントの導入では、モデル選定やPoCだけでなく、業務プロセスの再設計、権限設計、監査可能性、情報管理、品質管理、ROIの可視化までを接続して考えることが重要です。Qualitegは、戦略と技術を分断しない体制で、こうした課題に向き合います。

ご関心をお持ちの方は、ぜひお気軽にご相談ください。初期構想の整理から、ガバナンス設計、実行基盤の検討、導入後の運用定着まで、課題に応じてご一緒できます。

お問い合わせ先

https://qualiteg.com/contact?inquiry=consulting_business

次回予告

では、こうした責任分解の構造を踏まえて、企業は実務上何を設計すべきなのでしょうか。

第3回(最終回)では、品質保証の転換、人間レビューの限界、保険市場の動向を整理したうえで、「AIエージェント導入前に設計すべき5領域」と「経営として先に答えるべき3つの問い」を示します。

本稿は公開情報に基づく一般的な整理です。個別の法的判断や契約設計については、専門家にご相談くださいませ。