[自作日記5] マザーボードはどれがいい?

![[自作日記5] マザーボードはどれがいい?](/content/images/size/w1200/2024/04/gpu_machine_jisaku_05.png)

今回は、マザーボードの選定をします。

Junさんの買い物の続きをみるまえにもう一度チップセットについておさらいしておきましょう。

インテルの CoreシリーズCPUは 12世代、13世代ともに、CPUソケットが LGA 1700 となっており、多くの場合、12世代用のチップセットは13世代のCPUとも互換性がありますが、最新の機能や最適な性能を得るには、対応する世代のチップセットを使用することが推奨されます。

たとえば、12世代のインテルCoreシリーズCPU用に設計されている チップセットには以下のようなものがありますが、AI用途であればGPUを使いますので、Z690,H670のようなハイエンドチップセットを選ぶのが安全でしょう。

- Z690: 高性能チップセットで、オーバークロッキングサポート、PCIe 5.0 x16スロット、多数のPCIe 4.0レーン、高速なUSB 3.2 Gen 2x2接続、および高速ストレージのための複数のM.2スロットが提供されています。

- H670: オーバークロッキングはサポートしていませんが、それ以外の機能はZ690に近いチップセットです。

- B660: PCIe 5.0サポートが限定的で、オーバークロッキングもサポートされていませんが、コストパフォーマンスに優れてチップセットです。

- H610: 基本的な機能のみを提供し、PCIe 4.0や高速USBのサポートが制限されています。

では、ふたたび Junさんに視点をうつしましょう

③ マザーボードのチップセットは CPUが12世代ならZ690 か CPUが13世代ならZ790。ATX。

CPUは、

に絞り込んだけど、これに合うマザーボードは何にしようか。

チップセットはZ690かZ790か。

店員さんに相談すると AI用途(GPU搭載用途)で、12世代のCPUであれば、Z690、13世代のCPUであればZ790のチップセットのマザーボードがお薦めだそうです。

ここで1つ疑問が。

確か 13世代のCoreシリーズも、12世代のCoreシリーズもどちらも、CPUソケットは LGA1700 だったはず。

ということは、 Z690 チップセット搭載のマザーボードに 13世代の i5 13600 も搭載できるのではないだろうか。

この疑問を店員さんにぶつけてみました。

私「Z690チップセットのマザーボードに13世代の CoreシリーズCPUって載りますよね」

「うーん。それはマザーボードのサポートによりますね」

私「え?そうなんですか? 13世代のCPUもLGA1700 だから Z690 のチップセットでも動くと思ったのですが」

「確かに、同じ LGA1700 でも、 13世代のCPUが、Z690という12世代用のチップセットでもそのまま動くかというと、そういうわけではないんです。あくまでZ690は12世代用のチップセットなので。」

私「なるほど。じゃあマザーボードがZ690で、CPUが 13世代の Core i5 13600 という組み合わせは無しってことなんですね」

「完全に無しではないんです。」

私「え?」

「メーカーによってはZ690のマザーボードもファームウェアをアップデートすることで 13世代まで公式にサポートしてくれるものもあれば、なにもしないでもZ690チップセットマザーボードにそのまま13世代のCPUをのせたら、動いているという事例も数多くあります。ただ、対応がマザーボードやメーカーによっても異なりますので、個別にメーカーに確認していただくか、13世代にはZ790等13世代のためのチップセットを使っていただくのが良いかと思います」

私「なるほど、そういうことなんですね、理解できました。」

この件、これほど、食い下がったのには実は訳があります。

Z690 のマザーボードの方が安いんです。

当たり前かもしれませんが、最新のZ790はマザーボードは実売2万円くらい高い印象です。

だから、Core i5 13600 と Z690 だとバランスが良いとおもったのでした。

でも、質問していろいろ理解が深まったので、結論がでました。

店員さんとも相談して、 Z690マザーボードはZ790よりも安く、性能面でも12世代が13世代に比べてそれほど劣るわけではないため、Z690マザーボードで行くことにしました!

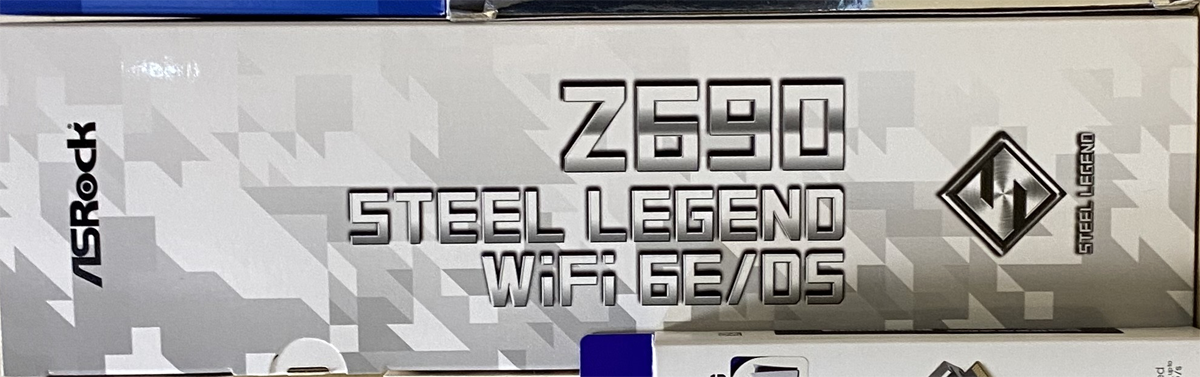

選んだマザーボードは、ASRock Z690 Steel Legend というやつです。3万円台後半で手に入りました!

ついに、1つめのパーツを購入できました!

そして、このマザーボードを選んだことで自動的に、CPUも決定しました!

12世代 i7 12700 に決定です!

同じお店で、CPUもゲットしました!12世代のIntel Corei7 12700Kです!

今回はいかがでしたでしょうか。Junさんは、性能と価格の近い2つのCPUで悩んでいましたが、今回はマザーボードの価格で判断しました。といっても妥協しているわけではなくZ690は12世代のチップセットのなかでは最高のもので、コストパフォーマンスがZ790に対して優れていたため、このような結果となったのでした。

PC自作はトータルバランスが重要です。お金が無限にあるわけではないので、どこに力をいれるか、どこはほどほどで良いか、こういう微調整の連続で、それがまた楽しく自作の醍醐味だと感じています。

さて、次回は、メモリや電源など周辺パーツの選定に移ります!

navigation