TOKYO DIGICONX 「MotionVox™」出展レポート

こんにちは!

2025年1月9日~11日に東京ビッグサイトにて開催された TOKYO DIGICONX に出展してまいりました。

開催中3日間の様子を簡単にレポートいたします!

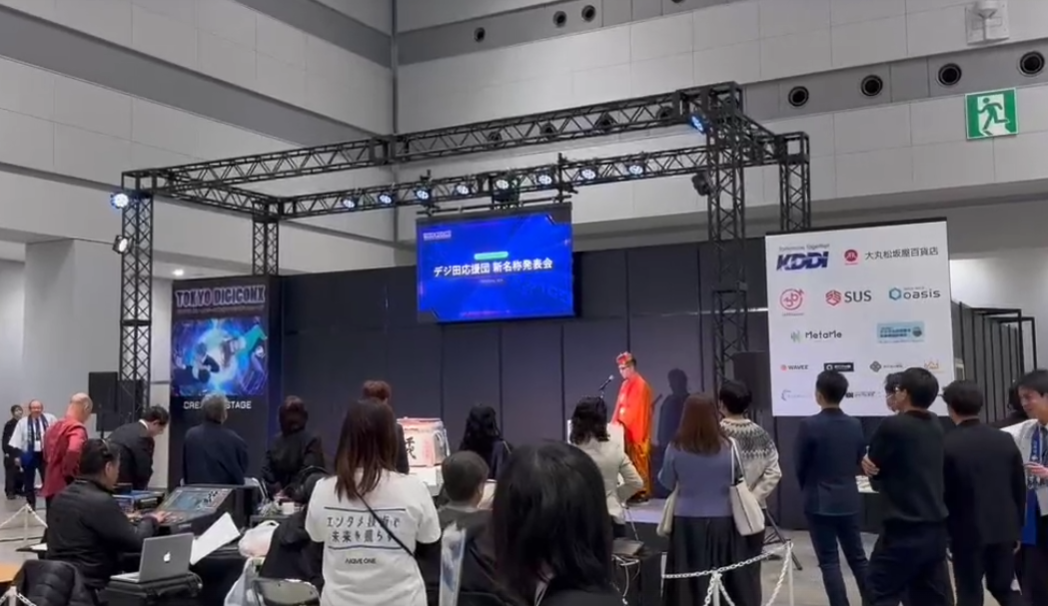

TOKYO DIGICONX

TOKYO DIGICONX は東京ビッグサイト南3・4ホールにて開催で、正式名称は『TOKYO XR・メタバース&コンテンツ ビジネスワールド』ということで、xR・メタバース・コンテンツ・AIと先端テクノロジーが集まる展示会です

「Motion Vox™」のお披露目を行いました

当社からは、新サービス「Motion Vox™」を中心とした展示をさせていただきました

MotionVox™は動画内の顔と声を簡単にAIアバター動画に変換できるAIアバター動画生成サービスです。

自分で撮影した動画をアップロードし、変換したい顔と声を選ぶだけの3ステップで完了。特別な機材は不要で、自然な表情とリップシンクを実現。

社内研修やYouTube配信、ドキュメンタリー制作など、幅広い用途で活用できます。

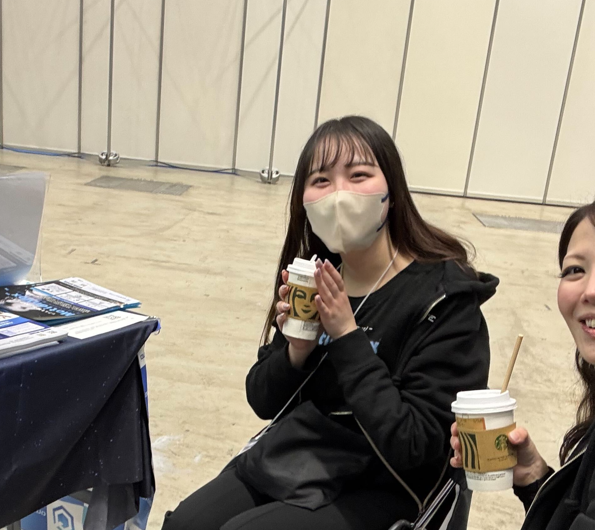

当社ブースの様子

「MotionVox™」の初出展ということで、当社はスタッフ3名体制、一同いつも以上に気合をいれて臨みました😊

ビジネスDAYである、初日と2日目は、多くの企業や自治体のお客様がご来訪くださいました。

「これ本物の人間じゃないの?」「自分の声が別人の声になるの?」など、デモンストレーションに対する新鮮な驚きの声をお聞かせいただきました。ほかにも、デモンストレーションをご予約いただいたり、世界のAI企業に負けないように、など応援や激励の声もいただきスタッフ一同大変感謝しております。

デモンストレーション

当日のデモンストレーション内容の一部を本ブログでもご紹介いたします!

MotionVoxの使い方

まとめと御礼

このたびの展示会、多くのお客様にご来場・ご期待いただき、誠にありがとうございました。

当日お客様からいただいた貴重なご意見、またデモ・アポイントメントご要望につきましては、順次ご連絡させていただきます!

Motion Vox™の可能性を広げていけるよう、より一層サービスの向上に努めてまいりますので、今後ともご支援のほど、よろしくお願い申し上げます。

番外編 ~ 写真でふりかえるDIGICONXの思い出😁 ~

今回はブース設営日、本番ともにとってもお天気にめぐまれました😊

SNSからも、ご来訪よびかけ。MotionVoxを使ってしゃべるポスター😉つくりました