AIプラットフォーマーの垂直統合と、残された戦略オプション

こんにちは!

Qualitegコンサルティングチームです!

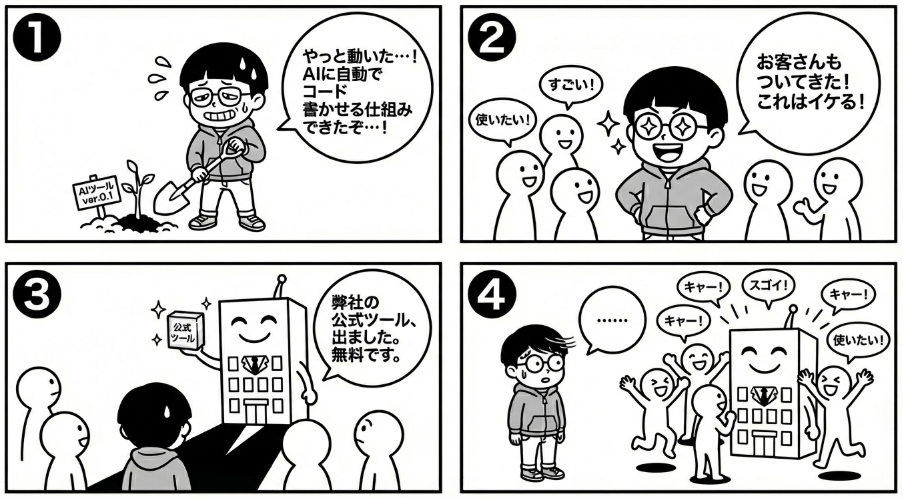

2026年現在、LLMの最大のユースケースの一つはコーディングだと考えています。実際、Menlo Venturesの調査でもコーディングはエンタープライズAI活用の代表的ユースケースとして位置づけられています。

そして、それにきづいたAIプラットフォーマー各社は自前のAIコーディングツールを次々と発表し人気を博しています。

逆にいえば、そのユースケースを早期に発見しプロダクト化してきた"コーディングSaaS"の開発企業は「胴元」であるAIプラットフォーマーが自分たちのSaaS領域に進出してきているわけで気が気でないでしょう。

ということで、本日はAIプラットフォーマーによる垂直統合と、私たちの取りうる戦略オプションについて考えてみたいと思います。

さて、2025年は、AIコーディングエージェント市場の勢力図が決定的に書き換えられた年でした。

Anthropicの「Claude Code」は2025年2月のリサーチプレビューから始まり、わずか半年で年換算ランレート(ARR)10億ドルに到達。

2026年初頭のアナリスト推計ではランレート25億ドル超に達しているとされます(※Investing.com掲載のReuters配信記事、およびMoneycontrol報道に基づく)。

Anthropicの全社ランレートも2025年初頭の約10億ドルから、同年8月には50億ドル超へ急伸しました。

実際、当社でもClaude Codeはフル活用されており、たとえばプロトタイプの初期構築やPR作成といった工程では、体感で従来の数倍〜十数倍の速度で進められるケースが出ています。

この数字が示しているのは、単に一つのプロダクトが成功したという話ではありません。AIの「モデル提供者」が「ツール提供者」へと垂直統合を進め、その過程でサードパーティのスタートアップが構築してきた市場を丸ごと取り込んでいくという、テクノロジー産業で繰り返されてきた構造的パターンが、AI領域でも再現されつつあるということです。

本稿では、この構造変化を冷静に整理したうえで、中国発オープンソースLLMとOSSエージェント基盤という二つの変数がもたらす影響、そしてその環境下でとりわけ私たちのような日本のスタートアップが取り得る戦略オプションについて考察します。

プラットフォーマーによる垂直統合の構造

APIビジネスに内在する情報の非対称性

まず、AIスタートアップが直面している構造的な不利について整理します。

AnthropicやOpenAIといったモデル提供者は、利用規約上、原則として顧客のAPIプロンプトをモデル学習に使用しないと明言しています。各社の規約には安全目的の保持やオプトアウト条件など細部の違いはありますが、基本方針としては受け止めてよいでしょう。

しかし、重要なのは、テキストの中身にアクセスしなくても、APIトラフィックのメタデータ——どの時間帯に、どのようなコンテキスト長で、どのツール呼び出しが、どのような順序と頻度で行われているか——は、インフラ運用上当然に把握されているという点です。

AIのプロフェッショナルにとって、このトラフィックの「形状」は極めて雄弁です。どのユースケースに需要が集中しているか、どのような設計パターンが成果を出しているかは、テキストを一行も読まずとも推測可能です。加えて、大口顧客であるスタートアップは、バグ報告やフィーチャーリクエストを通じて、最先端のエッジケースをプラットフォーマーに直接フィードバックします。

これは悪意の問題ではなく、構造の問題です。プラットフォーマーは、エコシステム全体が時間と資金を投じて行った市場検証の結果を、運営者としての立場から自然に観察できるポジションにいるのです。

「公式ツール」投入のインパクト

この情報の非対称性が最も顕在化するのは、プラットフォーマーが自ら公式ツールを投入する瞬間です。

Claude Codeの事例は象徴的です。

Anthropicは、自社の最新モデルに最適化された開発環境を、コマンドラインから直接操作可能なエージェントとして提供しました。サードパーティが複雑なプロンプトチェーンで実現していた機能が、シームレスな公式体験として統合される。ユーザーの移行は急速に進みます。

Menlo Venturesのレポート(※1)によれば、Anthropicはエンタープライズ市場で40%、コーディング領域では54%のシェアを獲得しています。AccentureはAnthropicとの提携を通じて約30,000人のプロフェッショナルにClaude Codeのトレーニングを実施する計画を発表しました(※2)。Snowflakeとは2億ドル規模の複数年パートナーシップを締結しています(※3)。

※1 Menlo Ventures "2025: The State of Generative AI in the Enterprise"

※2 Accenture公式プレスリリース(2025年12月9日)

Anthropic側告知

※3 Snowflake and Anthropic Announce $200 Million Partnership(Morningstar/Business Wire, 2025年12月3日)

このパターンは、AWSがサードパーティのインフラツールを自社サービスに統合してきた歴史、あるいはAppleがサードパーティアプリの機能をOSに取り込んできた歴史と構造的に同じです。プラットフォーマーは、エコシステムの成熟を待ってから、最も価値の高いレイヤーを自社に統合します。

ゲームの前提を変える二つの変数

変数①:中国発オープンLLMの台頭

この「胴元が勝つゲーム」の前提条件を根底から揺るがしているのが、中国発のオープンソースLLMです。

2025年1月に公開されたDeepSeek-R1は、総パラメータ671B(1トークンあたり37Bを活性化するMixture-of-Experts構造)を持ち、OpenAIのo1と同等の推論性能を達成したとされます。

公表された学習コストは約560万ドル。

この数字には研究開発やインフラ維持のコストが含まれておらず、SemiAnalysisの分析ではDeepSeekの総サーバー設備投資は約16億ドルと推計されています。それでも、西側の主要AI企業が一つのモデルに1億ドル以上を投じている中で、アーキテクチャの工夫によって大幅なコスト効率を実現したことは事実です。

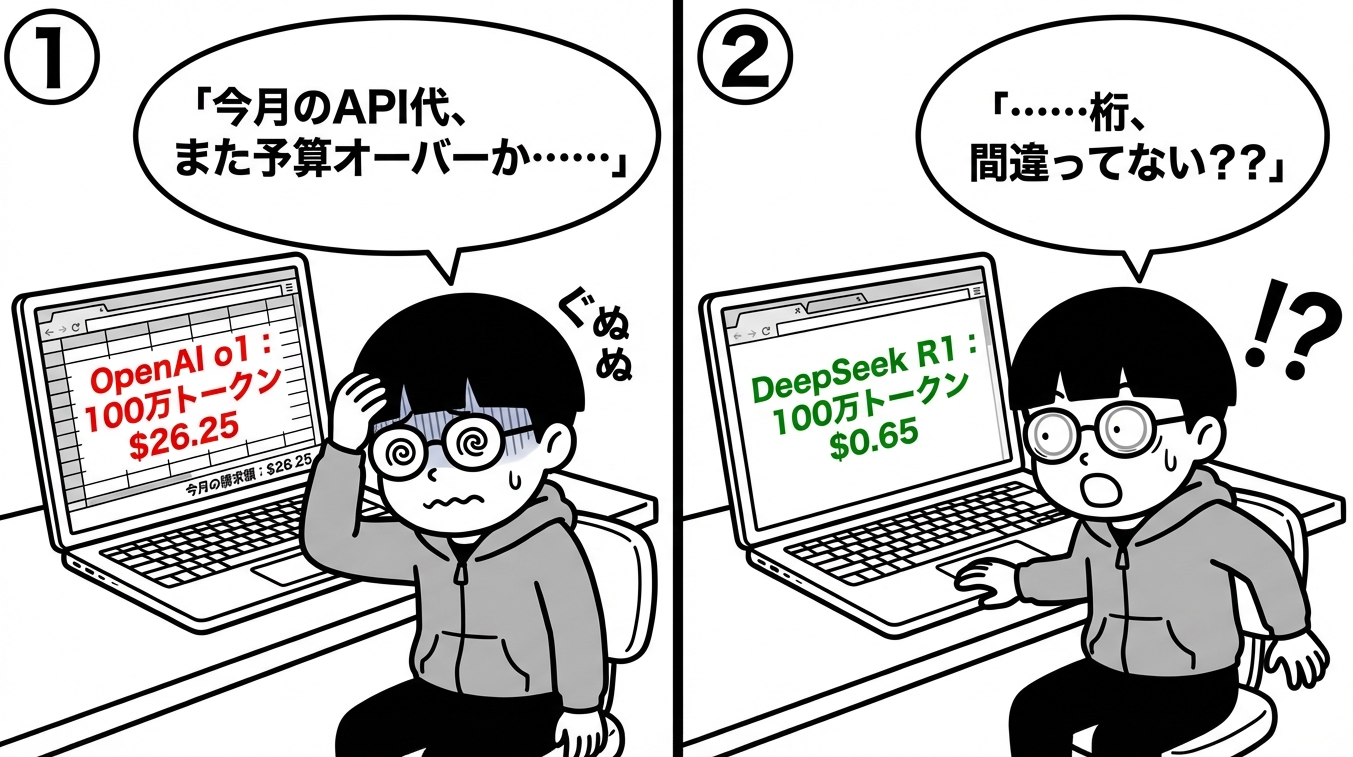

APIの価格差はさらに顕著です。

DeepSeek公式APIドキュメント(2025年時点)によれば、DeepSeek-R1の価格は入力$0.28/出力$0.42(100万トークンあたり、キャッシュミス時)です。入出力比3:1で計算したブレンドコストは約$0.32となります。一方、OpenAIのo1は入力$15/出力$60(同)で、同条件のブレンドコストは約$26.25です。価格差はおよそ80倍にのぼります(※各社の価格は改定される場合があります。DeepSeek: api-docs.deepseek.com、OpenAI: platform.openai.com 参照)。

一方、AlibabaのQwenシリーズも急速に存在感を高めています。

Qwen2.5-Coder-32Bは、Alibaba公開のレポートによれば、HumanEvalやLiveCodeBenchなどの主要コーディングベンチマークでオープンソースモデルの中でトップクラスの性能を達成し、GPT-4oに匹敵するスコアを示したとされています。

最新のQwen3-Coderについては、周辺報道やレビューサイトにおいてSWE-Bench Verifiedで69.6%を記録したとの報告があり、条件次第では米国の主要モデルに匹敵する水準とされています

(※VentureBeatおよびindex.devのレビューに基づく。同スコアは500ターン設定等の特定条件下での結果であり、設定によって変動する点に留意が必要です)。

ライセンスはApache 2.0で、商用利用が可能です。

これらのモデルがオープンウェイトで公開されていることの意味は明確です。スタートアップは、プラットフォーマーのAPIに依存せずに、フロンティアクラスの推論能力を自社環境で稼働させる選択肢を持つようになったのです。

変数②:OSSエージェント基盤の成熟

モデルだけでは十分ではありません。モデルを「動かす」ためのエージェント基盤も必要です。

この領域で注目すべきはOpenHandsです。

OpenHandsは2024年3月にプロジェクトが発足し、18か月でGitHubスター60,000以上、ダウンロード400万回以上を記録(Business Wire, 2025年11月18日発表時点)。

OpenHandsの設計思想で特筆すべきは、モデル非依存(model-agnostic)のアーキテクチャです。Claude、GPT、DeepSeek、Qwenなど、あらゆるLLMを差し替え可能な形で利用できます。実行環境はDockerサンドボックスで完全に隔離され、セルフホストにもクラウドデプロイにも対応します。MITライセンスのオープンソースです。

中国製オープンLLM × OSSエージェント基盤。この組み合わせは、理論上、プラットフォーマーのAPIに一切依存しない自律的な開発環境を構築できることを意味します。

楽観論に対する留保

ただし、この「自由な組み合わせ」がすべてのスタートアップにとって現実的な選択肢であるかどうかは、冷静に検討する必要があります。

運用コストの現実

オープンモデルのセルフホストには相応のインフラ投資が必要です。DeepSeek V3の完全版を稼働させるには8〜16基のA100/H100クラスGPUが必要とされ、初期投資は5万〜20万ドル、MLOps人員として1〜2名のフルタイムエンジニア(年間12万〜20万ドル)が求められます。「API課金から解放された」としても、インフラコストが上回るケースは十分にあり得ます。

地政学的リスク

イタリアでは2025年1月末にデータ保護当局(Garante)の指摘を受け、DeepSeek-R1のアプリがApp Store/Google Play Storeから利用不能となりました(Reuters, 2025年1月29日報道)。

EU全体で中国製モデルへの規制強化が進む可能性も指摘されています。エンタープライズ顧客に対して「中国製のモデルを使用している」という事実がセールス上のハードルとなるケースも想定すべきです。

信頼性の課題。 DeepSeek-R1は2025年1〜2月に数日間の部分停止を経験し、トークン消費後に空レスポンスを返す事象が報告されています。プロダクション環境で使用する場合、マルチプロバイダのフェイルオーバー設計が前提となり、その分のアーキテクチャ複雑性が発生します。

要するに、「API依存」と「フルセルフホスト」は二者択一ではなく、グラデーションの中でどこにポジションを取るかという判断が求められるのです。

この構造の中で、どこに勝ち筋があるのか

ここまでの整理を踏まえると、いくつかの問いが浮かび上がります。

「ドメイン特化」は、まだ堀になるのか?

率直に言えば、怪しくなっています。

建設業の専門知識をClaudeに聞けば相当な精度で返ってきます。医療も法律も同様です。

フロンティアモデルの汎用性能がここまで上がった以上、「AIが詳しいかどうか」で差をつけるのは年々難しくなっています。

では、プラットフォーマーが構造的に踏み込めない領域はどこか。

一つの仮説は「接続」です。

日本の中堅・中小企業のバックオフィスには、APIが存在しないオンプレミスシステム、紙ベースの業務フロー、独自フォーマットのExcelが依然として大量に残っています。大企業でも基幹システム間の連携は複雑で、AIを業務フローに統合するには個別の泥臭い実装が不可避です。

AnthropicもOpenAIも、この「最後の1マイル」を一社ずつ埋めに行くインセンティブはありません。彼らのビジネスモデルはAPIの提供であり、個別のシステムインテグレーションではないからです。

だとすれば、堀になり得るのは「AIの賢さ」ではなく

「AIを現場にフィットさせた実績と、そこから得られるフィードバックデータの蓄積」

ではないか。

これはモデルが変わっても、公式ツールが出ても、簡単には複製されません。ただし、この仮説が正しいかどうかは、各社が自分の顧客と市場で検証するしかありません。

モデル非依存設計は、もはや「衛生要件」か?

2024年にはClaude 3.5 Sonnetが圧倒的でした。2025年にはDeepSeek-R1が台頭し、QwenシリーズがSWE-Benchで逆転する場面も出ています。今日の最適なモデルが半年後も最適である保証はどこにもありません。

OpenHandsがLiteLLMを通じて実現しているようなモデル非依存のアーキテクチャは、単なる技術的な好みの問題なのか、それとも経営上のリスク管理として必須の要件になりつつあるのか。Claude、GPT、DeepSeek、Qwenのどれにでも差し替えられる設計を最初から組んでおくコストと、特定モデルに最適化して短期的な性能を取るトレードオフを、どう判断するか。この問いに正解はありませんが、少なくとも意識的に選択している企業とそうでない企業では、1年後の立ち位置が大きく変わるはずです。

「秘伝のタレ」は、どのレイヤーに仕込むべきか?

プロンプトエンジニアリングの工夫——いわゆる「秘伝のタレ」——は、モデルのメジャーアップデート一回で陳腐化するリスクがあります。

Claude 3.5 Sonnetで最適化されたプロンプトチェーンが、Claude 4で不要になったケースは業界全体で多数報告されています。

であれば、持続的な優位性はモデル層ではなく、その外側——独自の業務データ、ユーザーのフィードバックループ、業界固有のナレッジベース、それらを活かすRAG(Retrieval-Augmented Generation)の仕組み——に構築すべきなのかもしれません。モデルが入れ替わっても残る資産はどこにあるか。この見極めが、おそらく今後数年のプロダクト設計における最も重要な問いの一つです。

OSSへの投資は「保険」として合理的か?

今すぐフルセルフホストに移行する必要があるかと問われれば、多くの企業にとって答えはNoでしょう。しかし、OpenHandsやvLLMの動向をウォッチし、社内で小規模なPoCを回しておくことのコストは、それほど大きくありません。

プラットフォーマーがAPI仕様を変更したとき、料金体系を改定したとき、特定機能を廃止したとき、「プランB」を発動できる状態にあるかどうか。このオプションバリューをどう評価するかは、各社のリスク許容度と事業構造に依存します。ただ、このオプションが「ゼロコストで手に入るもの」から「相応の投資で初めて確保できるもの」に変わりつつあることは、認識しておいて損はないはずです。

おわりに

本稿で整理した構造は、決して悲観的なものではありません。

プラットフォーマーによる垂直統合の圧力は確かに強まっています。

しかし同時に、中国発のオープンLLMとOSSエージェント基盤の成熟が、「API依存の一本足打法」以外の選択肢を現実的なものにしました。

すべてをプラットフォーマーに委ねるのでもなく、すべてを自前で抱えるのでもない。このグラデーションの中でどこにポジションを取るかという判断の余地が生まれたこと自体が、この1年の最も大きな変化です。

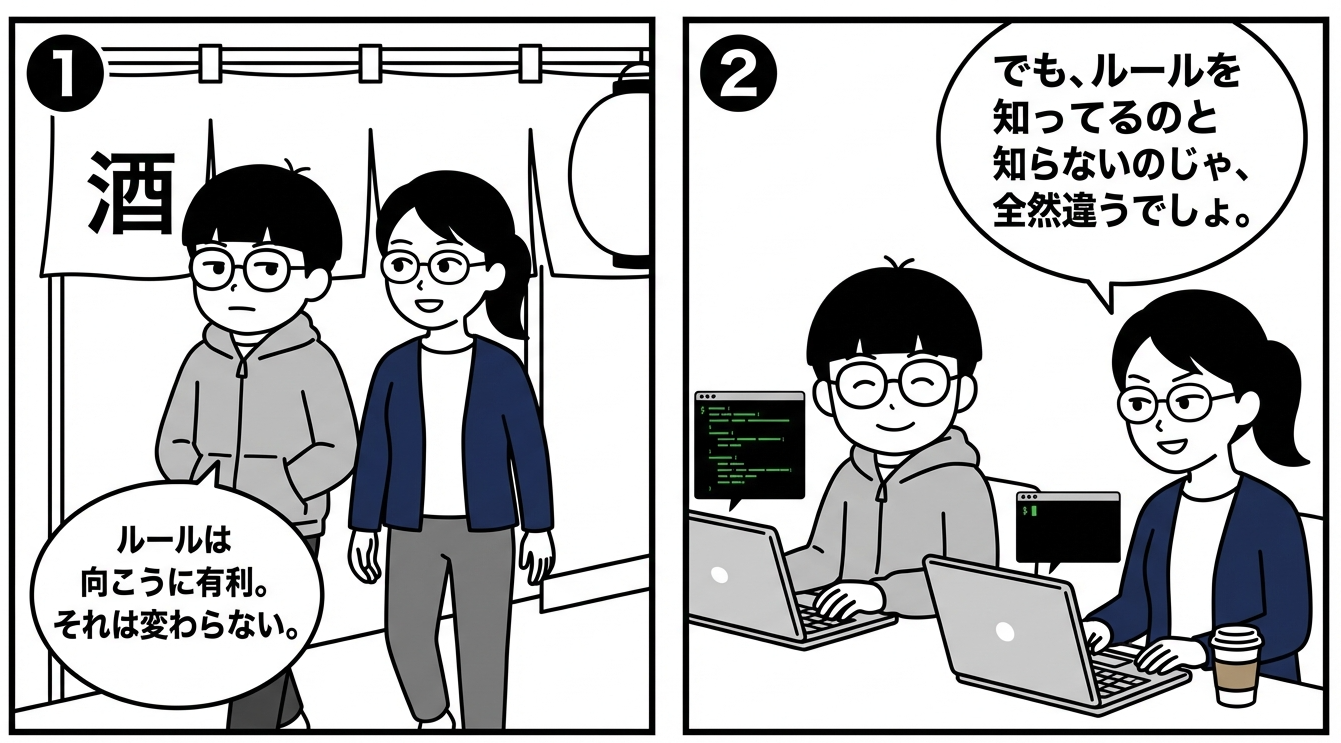

テクノロジー産業のゲームのルールが、インフラを握るプラットフォーマーに有利にできていることは否定できません。

ただ、ルールを正確に把握したうえでテーブルに着くのと、把握せずに座るのとでは、結果はまるで違います。

ただ最後に、強調しておきたいことがあります。

ここまで「垂直統合の圧力」や「胴元が有利な構造」を論じてきましたが、それはプラットフォーマーを善悪で裁きたいからではありません。

そもそもこの市場そのものを開いたのは、OpenAIがChatGPTという形で生成AIを一般に解放し、使える道具として社会に根付かせたことでした。

あの転換がなければ、私たちを含む多くのスタートアップの挑戦も、議論の土俵も、存在しなかったはずです。

私たちはその上に立って事業をしている以上、敬意を持ってこのエコシステムに参加したい。

同時に、敬意と戦略は両立します。ルールを作った人をリスペクトしながら、そのルールの中でどう勝ち筋を作るかを考える——本稿がそのための補助線になれば幸いです。

出典・参考記事リスト

- Menlo Ventures(Enterprise向け生成AIレポート:シェア推計など)

- Investing.com(Reuters配信:Anthropicのランレート等に触れている記事)

- Moneycontrol(Reuters系:Claude Codeのrun-rate $2.5B超などに触れている記事)

- Reuters(イタリアでDeepSeekアプリが利用不能になった件:2025/1/29頃の報道)

- OpenAI 公式ドキュメント(o1:モデル/価格の前提に使ったページ)

- DeepSeek 公式APIドキュメント(Pricing:入力/出力単価の前提に使ったページ)

- SWE-bench Verified(ベンチマークの参照元)

- Business Wire(OpenHandsのSeries A・スター数・DL数など)