LLM

LLM推論基盤プロビジョニング講座 第4回 推論エンジンの選定

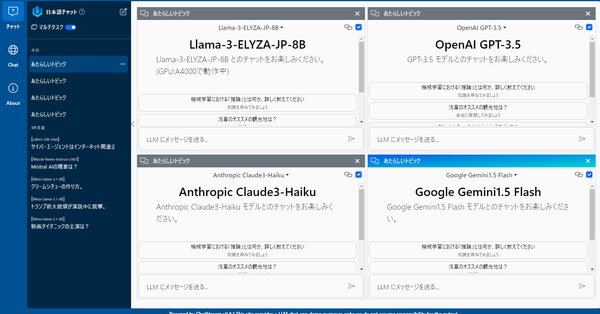

こんにちは!前回までの講座では、LLMサービス構築に必要なリクエスト数の見積もりや、使用モデルの推論時消費メモリ計算について詳しく解説してきました。今回は7ステッププロセスの4番目、「推論エンジンの選定」について詳しく掘り下げていきます。 LLM推論基盤プロビジョニング講座 シリーズ記事一覧 * 第1回 基本概念と推論速度 * 第2回 LLMサービスのリクエスト数を見積もる * 第3回 使用モデルの推論時消費メモリ見積もり * 第4回 推論エンジンの選定 * 第5回 GPUノード構成から負荷試験までの実践プロセス * 番外編 KVキャッシュのオフロード戦略とGQA 推論エンジンとは何か 推論エンジンとは、GPU上でLLMモデルの推論計算(テキスト生成)を効率的に行うために設計された専用のソフトウェアプログラムです。一般的なディープラーニングフレームワーク(PyTorch、TensorFlowなど)でも推論は可能ですが、実運用環境では専用の推論エンジンを使用することで、大幅なパフォーマンス向上とリソース効率化が期待できます。 推論エンジンは単なる実行環境ではなく

![[ChatStream] meta-llama/Meta-Llama-3-8B-Instruct 用の ChatPromptクラス](/content/images/size/w600/2024/04/ChatPrompt--4-.png)

![[ChatStream] Rakuten/RakutenAI-7B-chat用の ChatPrompt](/content/images/size/w600/2024/04/ChatPrompt--2-.png)

![[ChatStream] lightblue/karasu-7B-chat-plus 用 ChatPrompt](/content/images/size/w600/2024/04/prompt_new.webp)

![[ChatStream] Llama2 対応の ChatPrompt実装](/content/images/size/w600/2024/04/llama_happy.webp)

![[ChatStream] rinna/nekomata-14b-instruction 用の ChatPromptクラス](/content/images/size/w600/2024/04/ChatPrompt--3-.png)

![[ChatStream] 時間のかかるモデル読み込みにプログレスバーをつける](/content/images/size/w600/2024/04/progress.webp)

![[ChatStream] Transformer応答をモックする Transformer Mock](/content/images/size/w600/2024/04/Transformer--1-.png)

![[ChatStream] LLMの読み込みが長いときは Generator Mock レスポンス](/content/images/size/w600/2024/04/Transformer--2-.png)

![[ChatStream] コンソールチャットの作成](https://images.unsplash.com/photo-1629654291663-b91ad427698f?crop=entropy&cs=tinysrgb&fit=max&fm=jpg&ixid=M3wxMTc3M3wwfDF8c2VhcmNofDE0fHxjb21tYW5kJTIwbGluZXxlbnwwfHx8fDE3MTI4Mjc0Mjh8MA&ixlib=rb-4.0.3&q=80&w=600)

![[ChatStream] Web サーバー(ASGI server) の起動](https://images.unsplash.com/photo-1628719210599-71124499eab5?crop=entropy&cs=tinysrgb&fit=max&fm=jpg&ixid=M3wxMTc3M3wwfDF8c2VhcmNofDI0fHx1bmljb3JufGVufDB8fHx8MTcxMjgyNzAxMnww&ixlib=rb-4.0.3&q=80&w=600)

![[ChatStream] キューイングシステムと同時処理制限](/content/images/size/w600/2024/04/queueing_system_cover.gif)