日々の開発Tips

Node.jsのUUID生成を極める:crypto.randomUUID() vs 通常のUUID

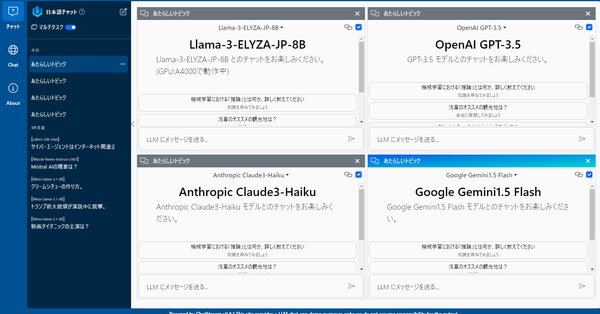

こんにちは! 今回は、Webフロントで活躍するNode.jsでのUUID生成について、特にcrypto.randomUUID()と従来の方法の違いを解説します! はじめに UUIDは一意の識別子として広く使用されていますが、Node.jsには複数の生成方法があります。 crypto.randomUUID()の使用方法 import { randomUUID } from 'crypto'; const id = randomUUID(); console.log(id); // 例:'123e4567-e89b-12d3-a456-426614174000' または、以下のように書いてもいいですね import crypto from 'crypto'; const id= crypto.randomUUID(); 主な特徴 * 暗号学的に安全な乱数生成器を使用 * 追加のパッケージインストールが不要 * パフォーマンスが最適化済み * UUID v4形式を生成 従来のUUID生成方法 import

![【極めればこのテンソル操作 】tensor.unsqueeze(0)と array[None] の違い](https://images.unsplash.com/photo-1618912617207-0c06851b2dc9?crop=entropy&cs=tinysrgb&fit=max&fm=jpg&ixid=M3wxMTc3M3wwfDF8c2VhcmNofDQ1fHxzcXVlZXplfGVufDB8fHx8MTcyNjExNjYxNHww&ixlib=rb-4.0.3&q=80&w=600)