LLM

LLM推論基盤プロビジョニング講座 第2回 LLMサービスのリクエスト数を見積もる

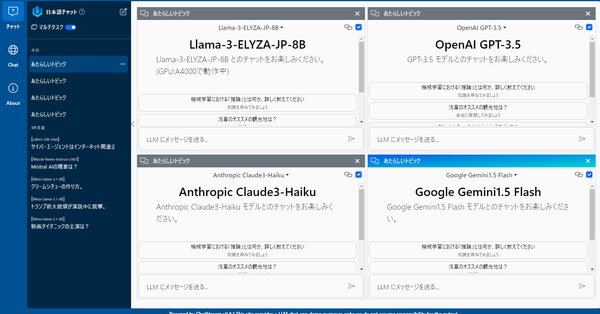

こんにちは! 今回はLLM推論基盤プロビジョニング講座 第2回です! LLM推論基盤プロビジョニング講座 シリーズ記事一覧 * 第1回 基本概念と推論速度 * 第2回 LLMサービスのリクエスト数を見積もる * 第3回 使用モデルの推論時消費メモリ見積もり * 第4回 推論エンジンの選定 * 第5回 GPUノード構成から負荷試験までの実践プロセス * 番外編 KVキャッシュのオフロード戦略とGQA STEP2 LLMサービスへのリクエスト数見積もり それでは、早速、LLM推論基盤プロビジョニングの第2ステップである「リクエスト数見積もり」の重要性と方法を解説いたします。 LLMサービスを構築する際に必要となるGPUノード数を適切に見積もるためには、まずサービスに対して想定されるリクエスト数を正確に予測する必要があります。 リクエスト数見積もりの基本的な考え方 LLMサービスへの想定リクエスト数から必要なGPUノード数を算出するプロセスは、サービス設計において非常に重要です。過小評価すればサービス品質が低下し、過大評価すれば無駄なコストが発生します。こ

![[vLLM] To use CUDA with multiprocessing, you must use the 'spawn' start method の対処法](https://images.unsplash.com/photo-1597872200969-2b65d56bd16b?crop=entropy&cs=tinysrgb&fit=max&fm=jpg&ixid=M3wxMTc3M3wwfDF8c2VhcmNofDh8fGdwdXxlbnwwfHx8fDE3MzkyMzYxNTh8MA&ixlib=rb-4.0.3&q=80&w=600)